公開日:2023年08月24日

/

更新日:2024年04月16日

2022年11月に公開以来、たった2か月で世界のユーザー数が1億人に達したChatGPT。

新しいビジネスや人材不足解消、業務効率化に期待する企業も多い一方で、「情報漏えい」の問題が導入をためらわせる要因となっています。AppleやAmazonなど、社内での利用を禁止する企業もあるなか、従業員が安全に利用できるように解決策を模索する企業も多いのではないでしょうか。

この記事では、ChatGPTをビジネスで安全に活用するためのポイントを、情報漏えい事故事例やビジネスでの活用事例とともにご紹介します。この記事は、2023年8月24日時点の情報をもとに作成しています。

ChatGPTとは?ビジネスへの活用状況は?

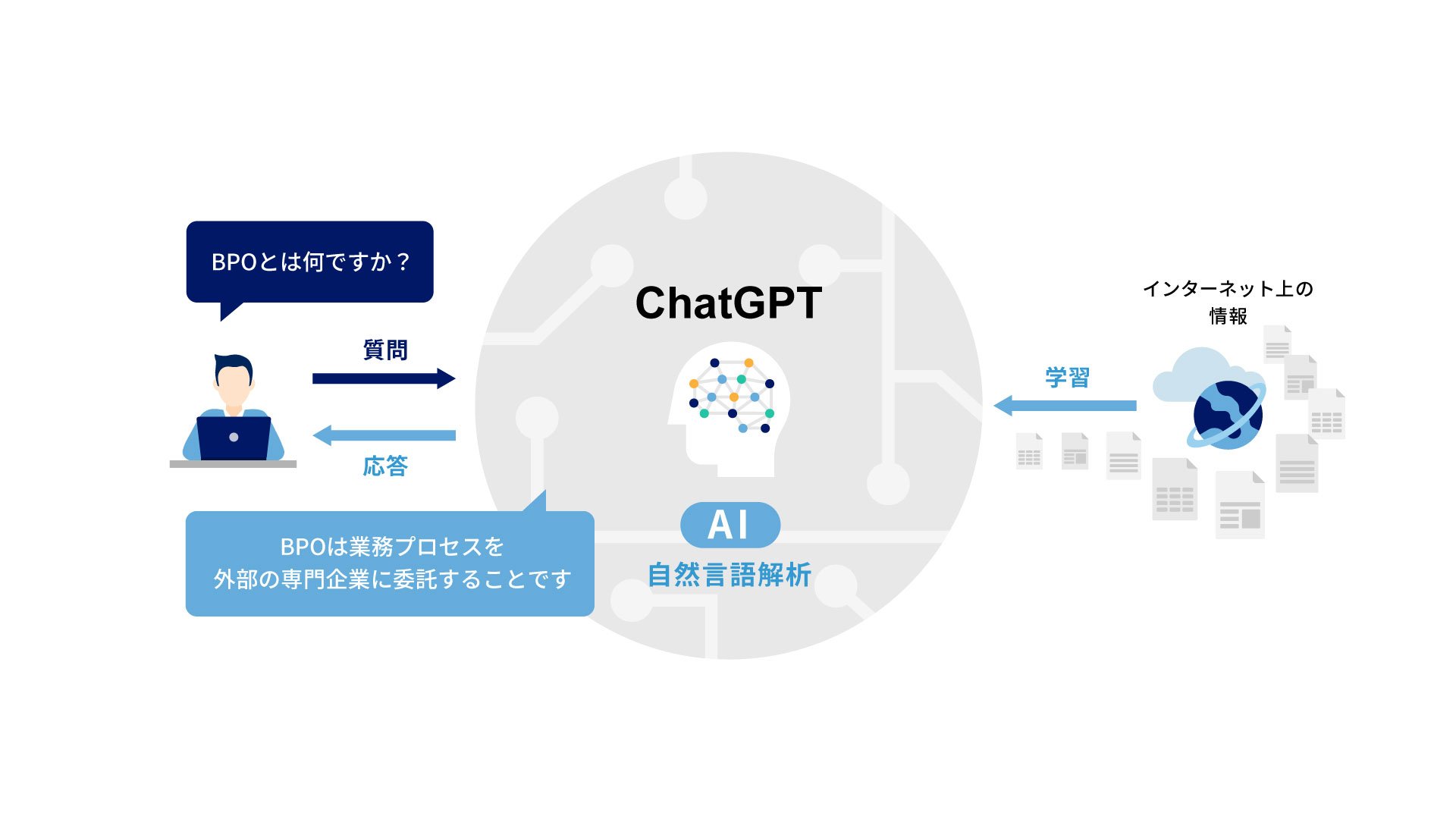

ChatGPTは、OpenAIが開発した自然言語処理を用いたAI技術のひとつで、人間が書いたような滑らかな文章を生成することができます。会話形式での質問応答や文章の執筆、要約、校正、翻訳、プログラムの作成など、用途は多岐にわたります。

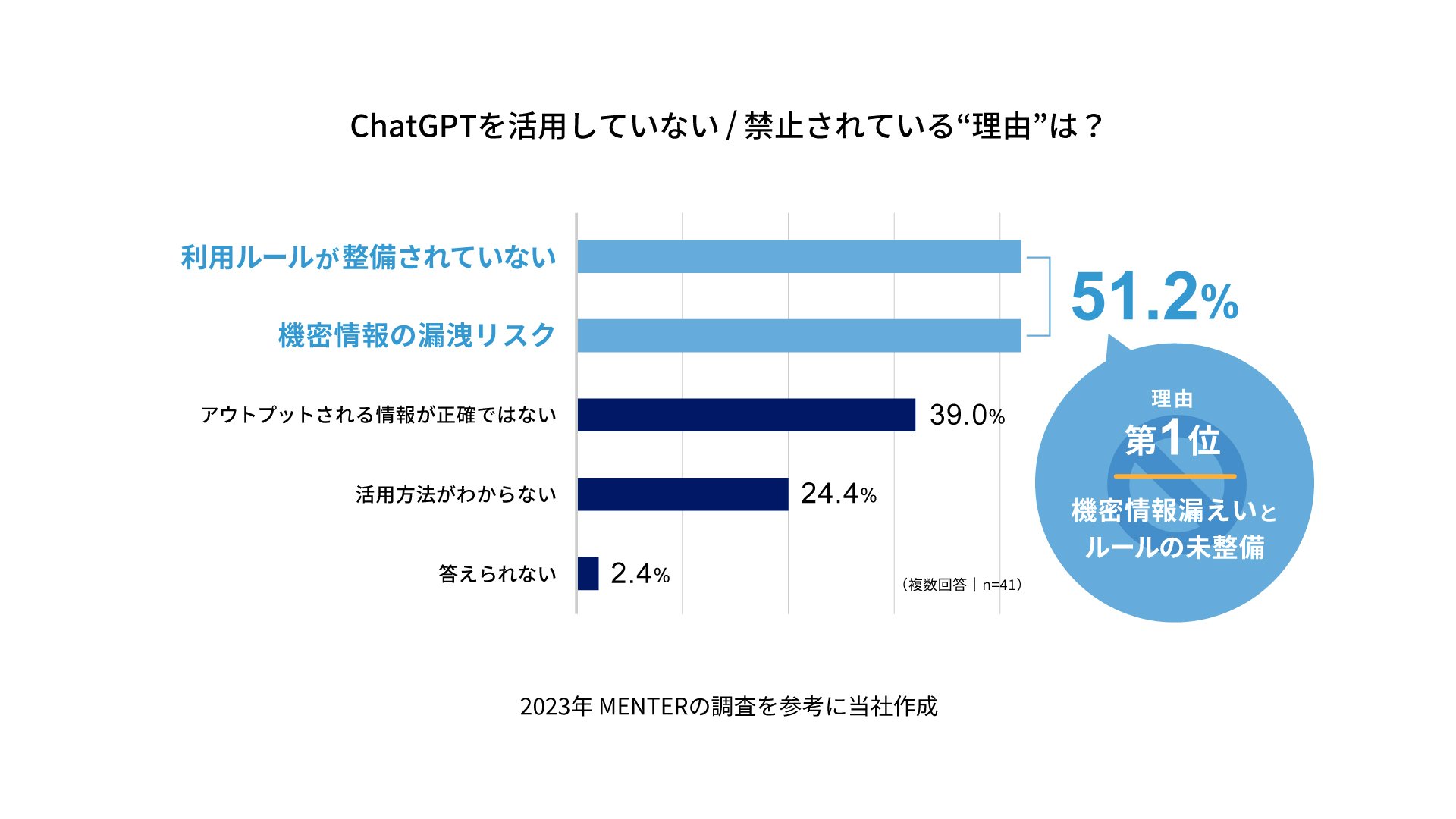

気になる企業でのChatGPTの活用状況については、情報システム部責任者257名への調査*1によると、70%が「とても活用している/やや活用している」、16%が「活用していない/利用禁止されている」と回答し、活用している企業が想定より多い状況が伺えました。

一方で、「活用していない/利用禁止されている」理由については、「利用ルールが整備されていない」「機密情報の漏洩リスク」が同率1位で、やはりセキュリティ上の懸念がビジネスでの活用を押しとどめていることがわかりました。

*1 出典:WHITE株式会社 情報システム部責任者257名への「ChatGPTに関する実態調査」 (参照:2023年4月20日)

なぜ情報漏えいのリスクがあるのか?

では、なぜ情報漏えいのリスクがあるのか、その理由を2つご紹介します。

まず1つ目は、ChatGPTが高度な応答を可能にするために、利用者が入力した情報を学習データとして使用する可能性がある点です。これにより、例えば、翻訳のために入力した社外秘文書が、誰かの質問への回答に使用されるといったことが起こり得ます。ただし、学習に使用されるのはWeb版のみで、回避することも可能ですので、その方法については後ほどご紹介します。

2つ目は、ChatGPTに入力した情報がOpenAIのサーバーに一時的に保存されるためです。もちろんセキュリティ措置がとられているとはいえ、ハッキングや不正アクセスによる情報漏えいの可能性はゼロとはいえません。

これらの理由から、機密情報や個人情報は入力しない方が安全といえそうです。

ChatGPTのビジネス利用上の情報漏えい事故事例

「機密情報や個人情報を入力してはいけない」と理屈ではわかっていても、実際に使ってみると思わぬ事故が起きるかもしれません。以下では、実際に起きた2つの事故事例をご紹介します。

事例(1):会議音声のテキストデータをChatGPTに入力し、議事録の作成を試みた

議事録の作成は思いのほか時間がかかるものですよね。ChatGPTを活用したい人も多いと思いますが、何が問題だったのでしょうか。議事録を漏えいした場合に起こりうる問題を以下に挙げてみました。

- 参加者の個人情報漏えいによるプライバシー侵害

- 企業の戦略的な意思決定の漏えいによる経済的損失

- 顧客情報漏えいによる信頼の失墜

などが考えられます。もちろん、機密情報や個人情報が含まれていない場合もあるため、内容を見極めて使う必要があるでしょう。

事例(2):自社製品の欠陥を直すために、ソースコードの修正を依頼した

ChatGPTによるコーディングは、生産性の向上に期待されていますが、何が問題なのでしょうか。ソースコードの漏えいによる問題を以下に挙げてみました。

- 他社が同様の製品・サービスを開発することでの経済的損失

- セキュリティ上の脆弱性やバグの露呈によるサイバー攻撃

- アクセス情報やAPIキー、データベースの接続情報等の盗難による不正アクセスの被害

などが考えられます。ただし、「電卓ツール」のように、仕様やアルゴリズムが一般に認知され、かつセキュリティ上のリスクがないものについては、ChatGPTに依頼しても問題ないと考えられます。

ChatGPTのビジネス活用で気を付けるポイント

アクセスできる範囲を絞る

アクセス可能な従業員が増えるほど、管理が難しくなります。アクセス範囲を絞り、利用権限のない人からのアクセスを制御することが大切です。

企業で利用するうえでのポリシーを策定する

ChatGPTの利用目的や利用範囲を明確にし、機密情報や個人情報の取り扱いについても明文化しておくことが重要です。一般社団法人日本ディープラーニング協会(JDLA)が公開している「生成AIの利用ガイドライン」を参考にするのもおすすめです。

セキュリティ意識を高めるために、従業員に適切な教育を行う

意図しない情報漏えいを防ぐために、問題となる具体的なケースを示すことが大切です。また、ITパスポートやG検定など、デジタルリテラシー向上に役立つ資格を社員教育の一環として導入することも有効です。

Web版を利用の際は入力した情報を学習に利用されないようにする

学習に利用されないようにする方法として、チャット履歴をオフにする方法とオプトアウト申請を行う方法があります。

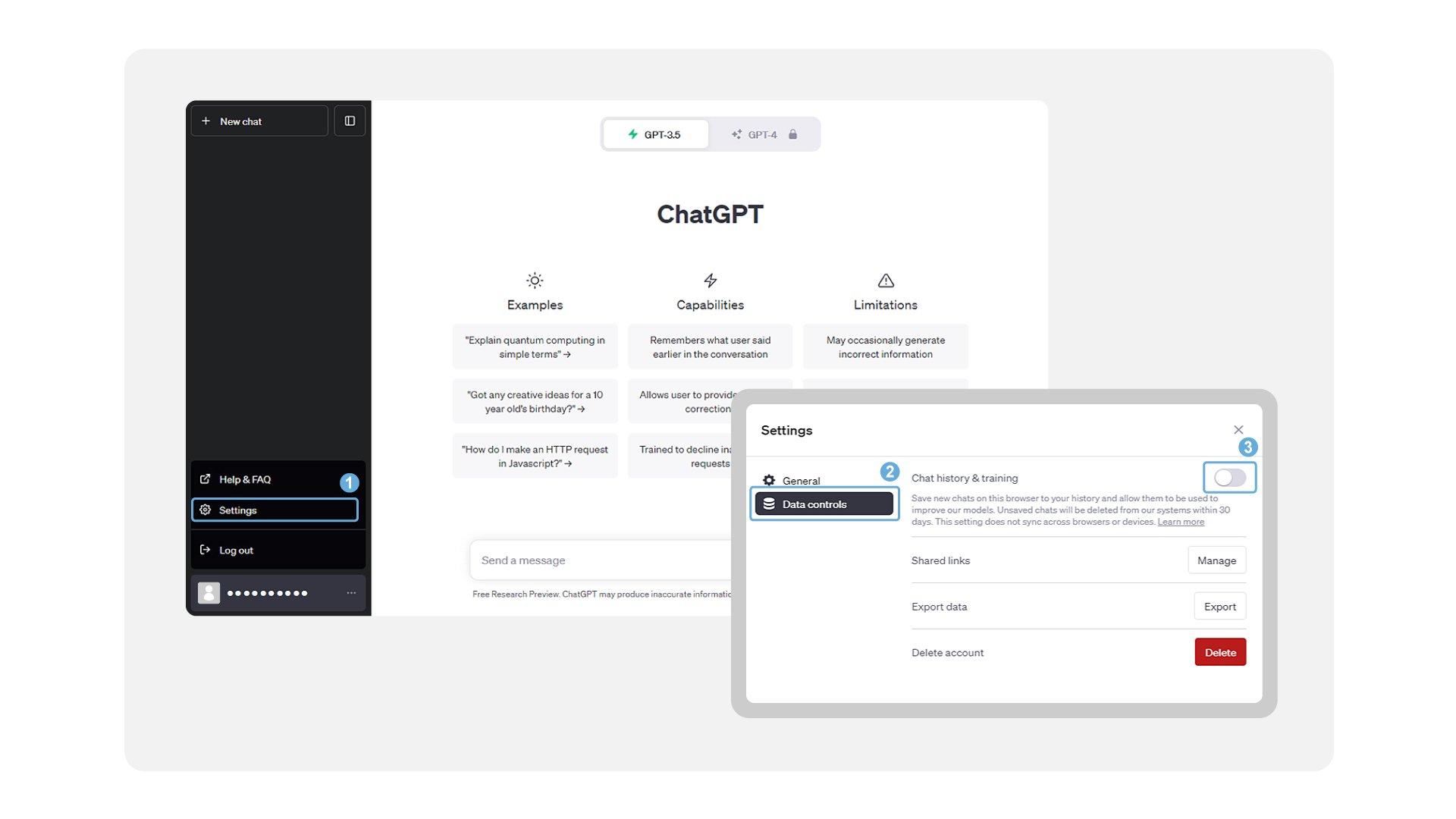

チャット履歴をオフにする方法

- 左メニューから「Settings」をクリック

- 「Data Controls」を開く

- 「Chat History & Training」をオフにする

オプトアウト申請方法

オプトアウトとは、製品やサービスを通じた個人データの第三者への提供を、本人の希望に応じて停止することです。申請は次の方法で行います。

- OpenAIの利用条件ページにアクセスする。

- 「3. Content」-「(c) Use of Content to Improve Services.」に記載のオプトアウト申請フォームへのリンク(下記「this form」の個所)をクリック

“(c) Use of Content to Improve Services. We do not use Content that you provide to or. receive from our API (“API Content”) to develop or improve our Services. We may use Content from Services other than our API (“Non-API Content”) to help develop and improve our Services. You can read more here about how Non-API Content may be used to improve model performance. If you do not want your Non-API Content used to improve Services, you can opt out by filling out this form. Please note that in some cases this may limit the ability of our Services to better address your specific use case.”

SCSKグループでの生成系AI活用事例

最後に、生成系 AI の安全・安心な活用を目指すSCSKグループの取り組みについてご紹介します。SCSK株式会社ではすべての従業員が利用できるクラウド環境の生成系AI「SCSK Generative AI」(SCSK-GAI)の運用を2023年5月から開始しました。

気になるセキュリティ面ですが、社内ネットワークからのみ利用可能で、利用者の入力情報の二次利用や第三者提供がされないため、セキュアな環境が保たれています。また、「生成系 AI 利用ガイドライン」も同時に整備され、従業員が安心して利用できる環境が整えられています。

従業員からは、「アイデアを出すのに便利」「文章作成にかかる時間が大幅に短縮できた」といった肯定的な意見も多く、着実に受け入れられているのが伺えました。

さまざまなリスクがあるなか、生成系AIのビジネスでの活用に踏み出すのは勇気がいることですが、従業員の不安を取り除くのが導入への第一歩といえそうです。

出典:SCSK株式会社 生成系 AI 「SCSK Generative AI」を全役職員が業務利用開始… (参照:2023年5月22日)

まとめ

ChatGPTは、生産性の向上や人材不足の解消につながる素晴らしい技術ですが、目に見えないリスクがあることも事実です。ビジネスで使用するためには、ルールの整備だけでなく、具体的なリスクを想定し、従業員のリテラシー向上を促すことが重要です。

SCSKサービスウェアでは、ウェビナー『生成AIをビジネスで活用する! DX人材育成「はじめの一歩」』(2023年7月19日配信)の無料アーカイブ配信を行っています。生成AIのビジネスでの活用事例や、DX人材の育成の仕方について、一般社団法人日本ディープラーニング協会(JDLA)から講師をお招きしてご紹介しています。ぜひこの機会にご視聴ください!

【アーカイブ配信】生成AIをビジネスで活用する!DX人材育成「はじめの一歩」

G検定の実施機関でもある日本ディープラーニング協会(JDLA)の高野氏をお招きし、デジタル人材育成に役立つノウハウや、Chat GPT・Bardに代表される生成AIとの付き合い方、企業のDX推進における課題解決方法などをご紹介します。